GSM8K中的三个问题示例,红色为计算的注释

在GSM8K数据集上,OpenAI测试了新方法验证(verification)和基线方法微调(fine-tuning)生成的答案。

即4种不同的解决方案:6B微调、6B 验证、175B 微调和 175B 验证。

在性能展示中,OpenAI提供了十个数学题实例,其中一个是的解决方案如下:

小明种了 5 棵树。他每年从每棵树上收集 6 个柠檬。他十年能得到多少柠檬?

175B 微调错误

6B 验证正确

现在的验证器具体训练方法分为三步走:

先把模型的「生成器」在训练集上进行2个epoch的微调。

从生成器中为每个训练问题抽取100个解答,并将每个解答标记为正确或不正确。

在数据集上,验证器再训练单个epoch。

生成器只训练2个epoch是因为2个epoch的训练就足够学习这个领域的基本技能了。如果采用更长时间的训练,生成的解决方案会过度拟合。

测试时,解决一个新问题,首先要生成100个候选解决方案,然后由验证器打分,排名最高的解决方案会被最后选中。

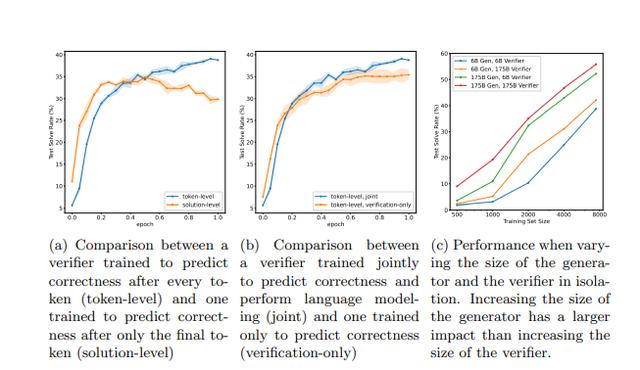

训练验证器既可以在全部的生成解决方案里进行单个标量预测(single scalar prediction),也可以在解决方案的每个 token 后进行单个标量预测,OpenAI 选择后者,即训练验证器在每个 token 之后进行预测。

如下图所示,它们分别标记为“解决方案级别”和“token 级别”。

在b图中,通过消融实验验证训练验证器中使用目标(objective)的作用, OpenAI 将使用两个目标与仅使用验证目标进行比较。

在c图中,OpenAI 对生成器和验证器的大小进行了实验,研究发现使用大的生成器、小的验证器组合性能显著优于小的生成器、大的验证器组合。

3 写在最后

通过OpenAI所展现出的10个数学实例是看出,使用验证方法比单纯扩大参数要更加智能,但缺点是并不稳定。比如在另一个问题实例中,仅有175B验证模型输出正确结果:小明是一所私立学校的院长,他有一个班。小红是一所公立学校的院长,他有两个班,每个班的人数是小明班级人数120人的1/8。问两所学校的总人数是多少?

AI发展道阻且长,目前绝大多数的机器学习仍依赖于数据堆砌,缺乏根本性的技术突破,存在一定的发展瓶颈。Google 工程总监 Ray Kurzweil 曾在采访中表示,直到 2029 年,人类才有超过 50% 的概率打造出 AGI 系统,还有一部分专家表示至少要到2099年或2200年。

现下,通过在一些简单的领域试验新路径,识别和避免机器学习的错误是推动模型发展的关键方法,比如这种简单的小学数学题。最终当我们试图将模型应用到逻辑上更复杂的领域时,那些不被了解的黑箱子将变得越来越透明。

参考链接:https://openai.com/blog/grade-school-math/

https://zhuanlan.zhihu.com/p/427877874

花粉社群VIP加油站

猜你喜欢