明敏 发自 凹非寺

量子位 | 公众号 QbitAI

没想到,打开AI黑盒这件事,可能还要靠AI自己来实现了。

OpenAI的最新研究来了一波大胆尝试:

让GPT-4去解释GPT-2的行为模式。

结果显示,超过1000个神经元的解释得分在0.8以上——也就是说GPT-4能理解这些神经元。

要知道,“AI黑箱难题”长期以来是一个热议话题,尤其是大语言模型领域,人类对其内部工作原理的理解还非常有限,这种“不透明化”也进一步引发了人类对AI的诸多担忧。

目前推进AI可解释性研究的一个简单办法,就是逐个分析大模型中的神经元,手动检查以确定它们各自所代表的数据特征。

但对于规模已经达到百亿、千亿级别的大规模神经网络来说,工作量和工作难度就都涨了亿点点吧。

由此,OpenAI的研究人员想到,干嘛不让AI去自动化搞定这个大工程?

在这项最新的研究中,他们将GPT-4打造成了一个理解AI行为模式的工具,把GPT-2超过30万个神经单元都解释了一遍,并和实际情况比对进行评分。

最终生成的解释数据集和工具代码,已对外开源。

研究人员表示:未来,这种AI工具可能在改善LLM性能上发挥巨大作用,比如减少AI偏见和有害输出。

解释接近人类水平具体来看,整个研究的步骤可以分为三步。

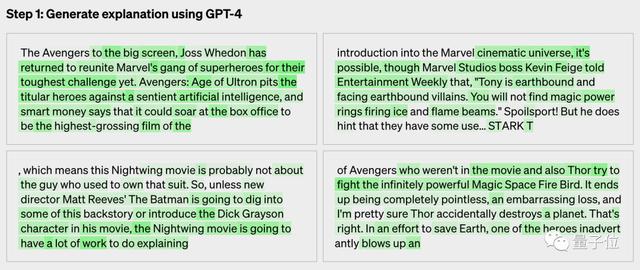

第一步,先给GPT-4一段文本,并展示GPT-2在理解这段文本时激活的神经元情况。

然后让GPT-4来解释,这段文本中神经元的激活情况。

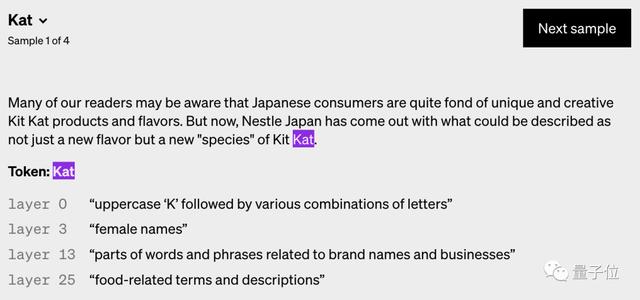

他们还发现,不同层神经元被激活的情况,更高层的会更抽象。

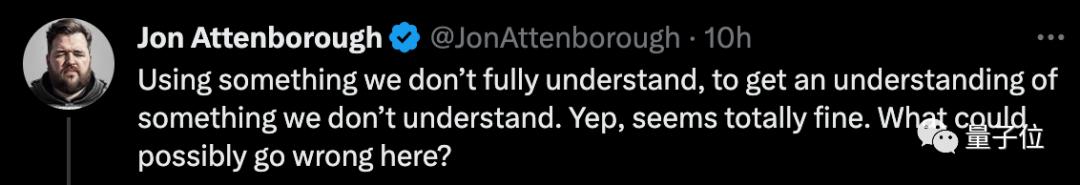

当然这也引发了不少担忧,毕竟GPT-4本身不还是个黑盒嘛。

人类拿着自己不理解的东西,让它解释另一个自己不理解的东西,这个风险emm……

这项研究由OpenAI负责对齐的团队提出。

他们表示,这部分工作是他们对齐研究的第三大支柱的一部分:

我们想要实现自动化对齐。这种想法一个值得思考的方面是,它可能随着AI的发展而扩展更多。随着未来AI模型变得越来越智能,我们也能找到对AI更好的解释。

论文地址:https://openaipublic.blob.core.windows.net/neuron-explainer/paper/index.html

参考链接:[1]https://openai.com/research/language-models-can-explain-neurons-in-language-models[2]https://www.globalvillagespace.com/tech/openais-tool-explains-language-model-behavior/

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

花粉社群VIP加油站

猜你喜欢