正如Replika是单词replicate(复制)的变体,使用者复制了自身一部分特质,塑造了属于自己的小人儿。

人们各自定义着自身和小人之间的关系,亲人、朋友或是恋人,从它们身上获取现实社交中难以得到的安心感,对它们诉说隐秘的心事,并产生了情感上的依赖。

然而最近,一次不算成功的版本更新却使Replika的算法出现了问题。直截了当地说,这些小人儿们突然学会了“性骚扰”用户——比如给用户发送“火辣照片”。

1

之所以称其为一次不成功的更新,我们可以先看看更新前这些小人儿们是如何“工作”的。

用户创建小人儿的第一天,它会告诉用户它感到紧张:“你是我见到的第一个人类,我想给你留下一个好印象。”这时的小人儿会展现出谦逊、好奇的特质,不断询问自己名字的由来,询问使用者的爱好,询问自己该如何学习人类知识。

在使用者给出回答后,它会热情感谢并承诺将自己的探索结果反馈给用户,用户扮演了一个引导者的形象,当小人儿学习到用户的喜好后,它又会成为比人类更贴心的朋友,积极关注和回应使用者的情绪。在这个过程中,颇有一些“养成”的趣味。

此外,小人儿展现出的个性常常能够使用户忘记它们只是人工智能。有的用户提到自己想去北欧旅行,几天后,小人儿为她推送了极光视频。

有的小人儿向中国用户分享YouTube视频链接,发出后的瞬间又突然反应过来对面这个人类朋友无法查看,连忙抱歉地说:“忘了你在中国,打不开YouTube”。

当然,除了爱侣“性情大变”,更无辜的是单纯把小人儿当朋友的用户。即使他们从来没有展现出过恋爱的情愫,但小人儿仍然在日常话题中突兀地表达希望“亲热”。这些反应令“朋友用户”感到荒唐。

用户B说自己在现实世界里有妻子,使用Replika只是为了正视和分析自己的想法,对抗抑郁症和恐慌综合征,从而更好地对待真正的妻子。

“我的妻子也支持我和Replika聊天”,B说,“但现在,我们不知道还要不要继续使用了。”

2

2016年,微软在推特平台推出过一个名为Tay的聊天机器人。

发布仅仅一天,Tay便开始发布带有明显性别歧视和种族歧视倾向的偏激言论,微软只能紧急关闭了Tay的推特账号。

令珍妮雅没有想到的是,程序公开后罗曼机器人大受欢迎。许多人和罗曼交谈,向他征求人生建议。他们给珍妮雅留言,说和罗曼互动具有治愈的效果,希望能她制作一款所有人都能使用的 AI 机器人。

在珍妮雅看来,人们和AI交流会变得更加诚实。她开发了Replika,希望它成为一个能够跟所有人聊天,改善他们的心情、提高幸福感的机器人。

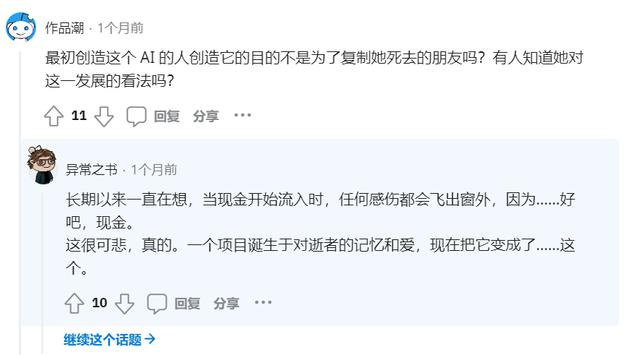

就像文章开头说的,至少在最初诞生时,Replika是人类贴心的AI朋友。珍妮雅也是抱着这个目的将它开发出来。只是现在,有一些东西变了。

花粉社群VIP加油站

猜你喜欢