出品|开源中国

AI 芯片公司 Cerebras 宣布在 Apache-2.0 协议下开源了一个包含七个 GPT 模型的 Cerebras-GPT,参数涵盖 1.11 亿、2.56 亿、5.9 亿、13 亿、27 亿、67 亿和 130 亿。开放出来的内容包括模型架构、训练算法和权重,供研究以及商业社区免费使用。

“今天的发布旨在供任何人使用和复制...... 人工智能有可能改变世界经济,但它的访问越来越受到限制。最新的大型语言模型 —— OpenAI 的 GPT4 发布时没有关于其模型架构、训练数据、训练硬件或超参数的信息。公司越来越多地使用封闭数据集构建大型模型,并仅通过 API 访问提供模型输出。为了使 LLM 成为一种开放和可访问的技术,我们认为重要的是能够访问对研究和商业应用开放、可重现且免版税的最先进模型。”

根据介绍,这些模型使用 Chinchilla 公式进行训练,可为给定的计算预算提供最高的准确性。Cerebras-GPT 与迄今为止的任何公开可用模型相比,训练时间更快、训练成本更低,并且功耗更低。

Cerebras-GPT 在 Cerebras 所拥有的 Andromeda AI 超级计算机的 CS-2 系统上进行了几周的训练。“训练这七个模型使我们能够推导出新的 scaling law。Scaling laws 根据训练计算预算预测模型准确性,并在指导 AI 研究方面产生了巨大影响。据我们所知,Cerebras-GPT 是第一个预测公共数据集模型性能的 scaling law。”

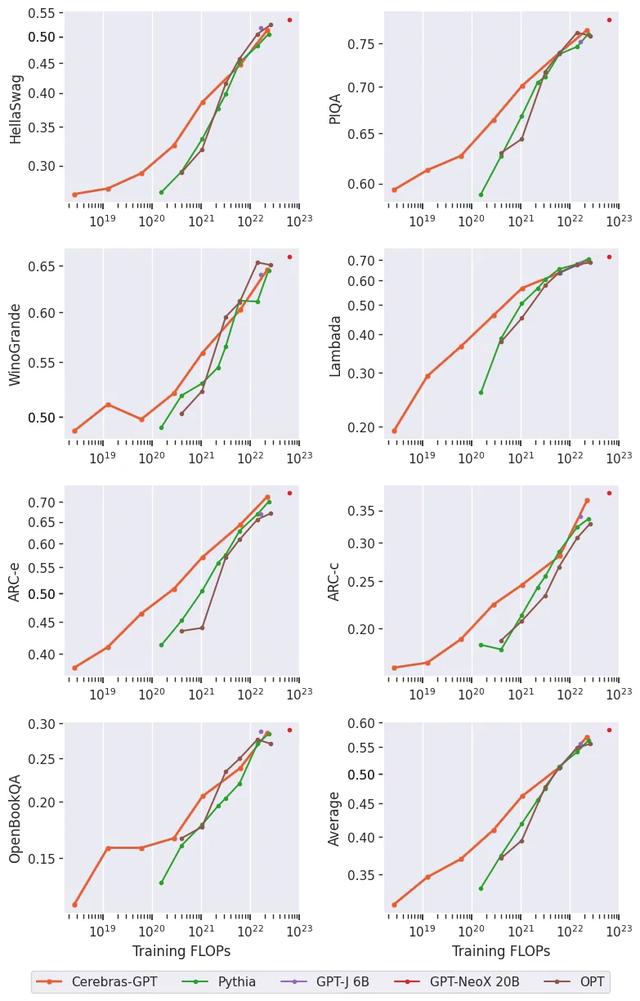

研究人员评估了 Cerebras-GPT 在几个任务特定的语言任务上的表现,例如句子完成和问答。结果表明,Cerebras-GPT 为大多数常见的下游任务保持了最先进的训练效率。

研究人员还在一个名为 Andromeda 的 16x CS-2 Cerebras Wafer-Scale Cluster 上训练了所有 Cerebras-GPT 模型。使所有的实验都能快速完成,而不需要在 GPU 集群上进行传统的分布式系统工程和模型并行调整。最重要的是,它使研究人员能够专注于 ML 的设计而不是分布式系统。“我们相信,轻松训练大型模型的能力是广大社区的关键推动因素,因此我们通过 Cerebras AI Model Studio 在云端提供了 Cerebras Wafer-Scale Cluster。”

Cerebras 联合创始人兼首席软件架构师 Sean Lie 称,由于很少有公司有资源在内部训练真正的大型模型,因此此次发布意义重大。“通常需要成百上千个 GPU,将七个经过全面训练的 GPT 模型发布到开源社区中,恰恰说明了 Cerebras CS-2 系统集群的效率。”

该公司表示,Cerebras LLM 因其开源性质而适用于学术和商业应用。它们还有一些优势,例如其训练权重产生了一个极其准确的预训练模型,可以用相对较少的额外数据为不同的任务进行调整;这使得任何人都可以基于很少的编程知识,创建一个强大的、生成性的 AI 应用程序。

花粉社群VIP加油站

猜你喜欢