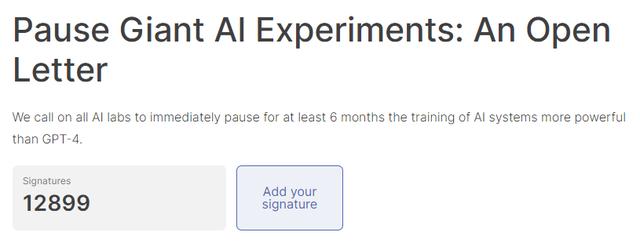

在新一轮AI全球竞赛爆发之际,一封呼吁暂停大型AI研究的公开信在科技圈掀起轩然大波。

近期,OpenAI 已经公布了GPT-4模型,其起草诉讼书、通过标准化考试和根据手绘草图建立工作网站的能力震惊四座。

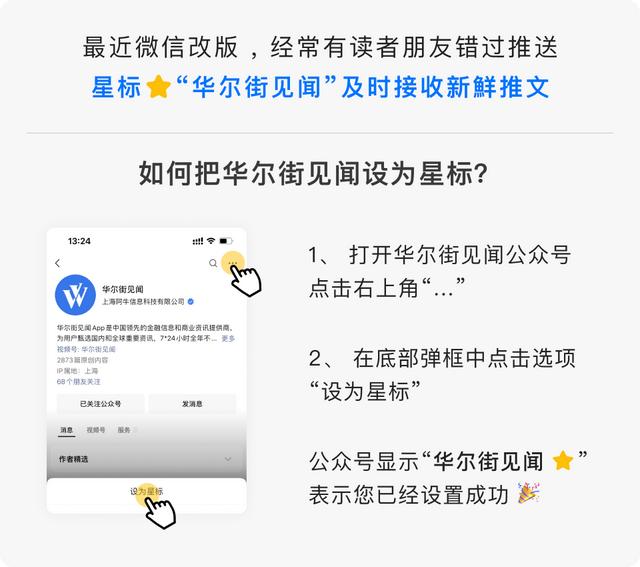

然而,就当所有人的注意力集中在签名的AI大佬身上时,华尔街见闻注意到这封公开信背后的生命未来研究所(Future of Life Institute,FLI)可一点都不简单。

将超人类主义和长期主义联系起来,根据Bostrom 和Ord的说法,成不了所谓的后人类会阻碍人类实现巨大而光荣的潜力,这将是“存在主义灾难”。

空间扩张主义指的是我们必须尽可能多地殖民未来的光锥(时空中的面): 即理论上我们可以进入的时空区域。

根据长期主义者的观点,我们未来的光锥包含了大量可利用的资源,他们称之为负熵的“宇宙禀赋”。

Ord写道,单单银河系的直径就有15万光年,包含了超过1000亿颗恒星,其中大部分都有自己的行星。要实现人类的长期潜力,我们只需要最终到达附近的一颗恒星,建立一个足够坚实的立足点,创造一个新的繁荣社会。

但为什么要这么做?让新的后人类文明洒满宇宙有什么重要的?

这就不得不提第三个组成部分: 总功利主义,这里简称为“功利主义”。

一些长期主义者坚称他们不是功利主义者,在一些人眼中,这只是一种烟雾弹行为。

比如,EA运动可能只是披着利他主义外衣的功利主义。

这项运动被称为EA运动之前,Ord等早期成员曾认真考虑过称之为“有效功利主义社区”。

功利主义并不在意价值是如何在时间和空间中分配的,重要的是总净额。

比如,假设现在有1万亿人,每个人的生命价值为1,那么总价值为1万亿,而如果现在有10亿人,每个人的生命价值为999,那么总价值为9990亿。在功利主义者眼中,第一个世界的价值更高。

这里的推测基于这样一个观点,即人只是价值的“容器”,本身并没有价值,人类存在的意义仅限于“容纳”了价值,更多的人意味着更多的价值。

简而言之,在功利主义者看来,人的存在是为了价值最大化,而不是为了造福人民。

这就是为什么长期主义者痴迷于计算未来有多少人可以存在。

Bostrom曾估计未来世界人类数量将达到1054,这一数字在他2014年出版的《超级智能》一书中更高,为1058。

最后总结一下长期主义者眼中的人类长期潜力:通过数字化技术增强的人类遍布银河系。

为了长期主义者的目标,人类不能把资源浪费在解决全球贫困问题和全球气候变暖上,反而应该把更多精力放在超级智能机器上,建立一个全球监视系统,发动“先发制人”的战争。

Beckstead甚至认为,人类应该优先考虑富裕国家人民的生活,而非贫穷国家人民,因为前者对未来的影响绝对更加重要。

为了实现价值最大化,人类必须开发越来越强大、越来越危险的技术; 如果做不到这一点,本身就将是一场生死存亡的灾难。不过,技术并不是导致全球性问题日益恶化的根本原因,也不是停止创造更多技术的理由。

有人认为,人类需要先进的技术逃离可能在未来十亿年内被太阳毁灭的地球,但在此之前,滥用技术更有可能导致人类灭绝。

最后,你怎么看长期主义?欢迎在留言中发表观点。

本文不构成个人投资建议,不代表平台观点,市场有风险,投资需谨慎,请独立判断和决策。

你怎么看长期主义?![]()

花粉社群VIP加油站

猜你喜欢