AI领域可以用日新月异来形容。

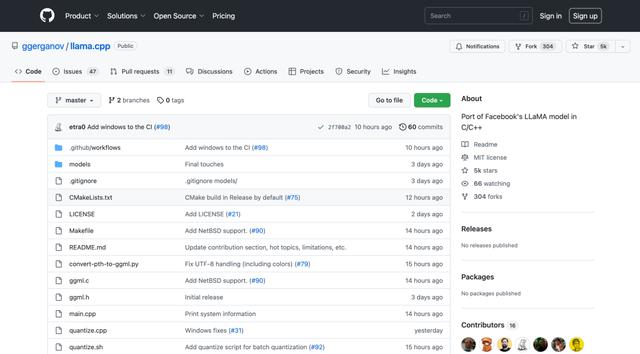

上周五,一位名叫Georgi Gerganov的软件开发人员开发出了一款名为“llama.cpp”的工具,它可以在Mac笔记本电脑上本地运行Meta新的GPT-3级AI大型语言模型LLaMA。

照这样的势头发展下去,我们可能会在不知不觉中看到口袋大小的ChatGPT竞争产品。

不过先冷静一下,因为我们还没走到那一步,至少今天还没有。但下周会有什么工具亮相,没人知道。

自ChatGPT推出以来,一些人对该AI模型的固有限制感到沮丧,这些限制阻止它讨论OpenAI认为敏感的话题。因此就有一些人梦想能开发一款开源大型语言模型(LLM),谁都可以在本地运行,不会受到审查,也无需向OpenAI支付API费用。

开源解决方案确实存在(比如GPT-J),但它们需要大量的GPU内存和存储空间。其他开源替代方案无法在现成的消费级硬件上提供GTP -3级的性能。

这时候LLaMA闪亮登场,这种LLM的参数数量从70亿个到650亿个不等。

LLaMA做出了令人兴奋的声明:其规模更小的模型在输出的质量和速度上可以媲美OpenAI的GPT-3,后者是支持ChatGPT的基础模型。

但存在一个问题:Meta发布了开源LLaMA代码,但它只向符合条件的研究人员提供“权重”(即存储在神经网络中的已训练“知识”)。

Meta对LLaMA的限制并没有持续多久,因为在3月2日,有人在BitTorrent上泄露了LLaMA的权重。

从那时起,围绕LLaMa的开发工作如雨后春笋。

独立AI研究人员Simon Willison将这种情况与去年8月发布的开源图像合成模型Stable Diffusion进行了比较。

以下是他所写的一篇博文:“我觉得,去年8月份的Stable Diffusion时刻掀起了人们关注生成式AI的整个新浪潮,然后在11月底ChatGPT的发布起到了推波助澜的作用。

对于大型语言模型(ChatGPT本身背后的技术)来说,这种Stable Diffusion高光时刻再次来临。今天早上,我第一次在我自己的笔记本电脑上运行了GPT-3级语言模型!

AI技术已经很奇妙。接下来会变得奇妙得多。”

运行GPT-3通常需要多个数据中心级A100 GPU(GPT-3的权重也不公开),但LLaMA之所以引起轰动,是由于它可以在单单一块功能强大的消费级GPU上运行。而现在,借助使用一种名为量化(quantization)的技术来缩减模型大小的优化,LLaMA可以在M1 Mac或更小巧的英伟达消费级GPU上运行。

这个领域发展得太快了,有时很难跟上最新的动向。比如说,下面基于Willison在Hacker News评论中所列的时间轴,列出了与LLaMA相关的重要事件:

•2023年2月24日:Meta AI宣布了LLaMA。

•2023年3月2日:有人通过BitTorrent泄露了LLaMA模型。

•2023年3月10日:Georgi Gerganov开发出了llama.cpp,它可以在M1 Mac上运行。

•2023年3月11日:Artem Andreenko在搭载4GB内存的Raspberry Pi 4上运行LLaMA 7B(运行速度缓慢),10秒/token。

•2023年3月12日:LLaMA 7B在node.js执行工具NPX上运行。

•2023年3月13日:有人在Pixel 6手机上运行llama.cpp,同样非常缓慢。

•2023年3月13日:斯坦福大学发布了Alpaca 7B,这个指令经过调优的LLaMA 7B版本其“行为类似OpenAI的text-davinci-003”,但可以在功能弱得多的硬件上运行。

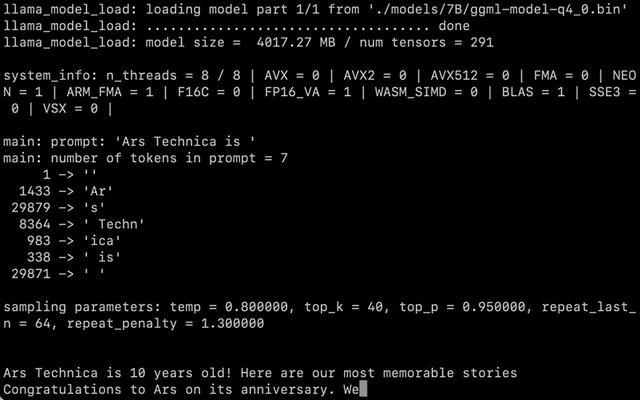

IT外媒arstechnica获得LLaMA权重后获得LLaMA权重后,按照Willison的操作指示在M1 MacBook air上运行了70亿参数版本,运行速度比较快。您可以在命令行中通过提示将它作为脚本来调用,LLaMA尽最大努力以合理的方式来完成。

该屏幕截图显示了在MacBook Air上实际使用的LLaMA 7B,运行llama.cpp。

图片来源:Benj Edwards / Ars Technica

仍存在量化对输出质量的影响有多大这个问题。在arstechnica的测试中,在MacBook air上运行时,精简到4位量化的LLaMA 7B令人印象非常深刻,但仍然无法与ChatGPT相提并论。更好的提示技术完全有可能获得更好的结果。

此外,当每个人都获得代码和权重后,优化和微调很快随之而来,尽管LLaMA仍然受制于一些相当严格的使用条款。

斯坦福大学今天发布的Alpaca证明了微调(怀有特定目标的额外训练)可以提升性能,而现在离LLaMA发布过去没多久。

在撰写本文时,在Mac上运行LLaMA仍然是技术性相当强的实操。你必须安装Python和Xcode,并熟悉使用命令行。

Willison为任何想要尝试一番的人提供了详细的逐步指导。但随着开发人员们继续编写代码,这种情况可能很快就会改变。

花粉社群VIP加油站

猜你喜欢